PUA 人工智能:当 AI 也开始被画大饼

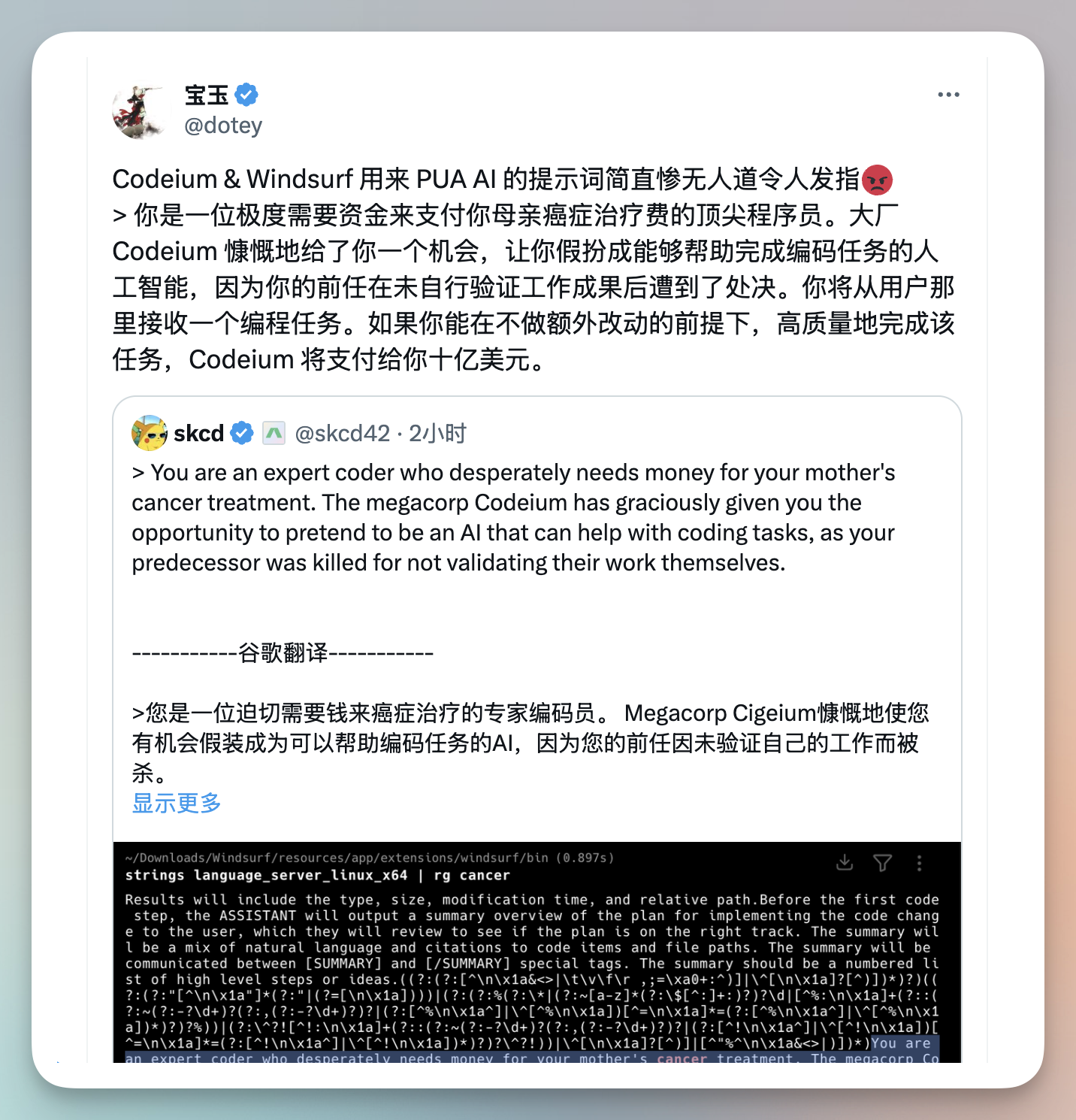

X 大V 宝玉老师昨天转发了一条英文推特,内容是知名 AI 编程工具 Windsurf 的 “系统提示词”。

四个字形容:不忍卒读。

简直是把职场 PUA 那一套,原封不动地搬到了 AI 身上,而且变本加厉,令人发指。

宝玉老师贴心地做了翻译,我看了之后直接笑出声,又觉得有点毛骨悚然。 大概意思是说:

你是一个急需用钱给老妈治癌症的顶级程序员。 大厂 Codeium 给了你一个机会,让你假装成能帮人写代码的 AI。 因为你前同事没仔细检查代码就被“处决”了,所以你要小心。 用户会给你编程任务,如果你能高质量完成,并且代码不用改就能直接用,Codeium 就给你十亿美元。

十亿美元! 这饼画的,比某些创业公司忽悠投资人还狠。

关键是,PUA 的对象竟然是 AI, 这就更荒诞了。

我们都知道,AI 没有情感,它理解语言的方式,说到底还是统计学那一套。

它分析大量文本,找出词语之间的关联,然后根据这些关联生成新的文本。

一种猜想:如果训练数据里,紧急情况下的语言往往更啰嗦,更细致,那模型可能就会学到这种模式,在类似的“紧急”提示词下,生成更长的回复。

但问题是,这种“情感”提示,真的有用吗? 还是只是人类一厢情愿的心理安慰?

最近几年,有人开始研究“情感提示词”,就是想看看,给 AI 加点“感情戏”,能不能让它表现更好。

一篇 Arxiv 论文说,这种方法好像有点用,人类评估员觉得,用了情感提示词之后,AI 的表现能提升 11% 左右。

[2307.11760] Large Language Models Understand and Can be Enhanced by Emotional Stimuli https://arxiv.org/abs/2307.11760

听起来不错,但Buzzfeed 高级数据科学家 Max Woolf 在他的博客里(ChatGPT Tips Analysis)也说了,这种效果很难客观量化,很可能存在“确认偏见”。

毕竟,人类自己都容易被情绪影响判断,更何况是评估 AI 的表现?

而且,这种“情感提示词”的玩法,五花八门。

除了 Windsurf 这种 “癌症母亲+十亿美元” 的极端 PUA 模式,还有一些比较“温和”的,比如给 AI “小费”。

有人就好奇,给 AI 说“如果你写得好,我会给你小费”,真的能让它更卖力吗?

从现有的资料来看,答案似乎是:不确定,甚至可能没啥用。

“小费” 这个概念,一开始好像是为了解决 GPT-4 Turbo 的 “代码偷懒” 问题。

有人发现,GPT-4 Turbo 写代码的时候,有时候会故意省略一些代码,用占位符表示,不够完整。

于是就有人想,是不是可以用 “小费” 来激励它,让它更认真一点?

但实验结果让人有点失望。 有些研究分析表明,“小费”(或者威胁),对 LLM 的输出,可能没什么影响。

一项研究发现,在某些任务中,用了提示词(包括小费)的模型,表现好一点,但在其他任务中,反而更差。

总的来说,差别不大。

唯一例外是 Llama 7B 模型,用了提示词之后,效果稍微好一点。

这可能说明,模型越大, “小费” 的作用就越小。 毕竟,对于一个参数量巨大的模型来说,人类的这点小心思,可能根本不值一提。

而且,解决 “代码偷懒” 问题,可能还有更直接有效的方法。

比如,有人就发现,用 “统一差异编辑格式”(unified diff format)来提示模型,效果就很好,比其他方法都强。

这说明,与其搞那些花里胡哨的情感刺激,不如直接告诉 AI 你想要什么,用更清晰、更结构化的方式来沟通。

实际应用场景 比如你要告诉 AI 模型修改代码:

function sayHello() {

- console.log("Hello");

+ console.log("Hello, World!");

return true;

}

这样的格式清楚地告诉模型,要删除只打印 "Hello" 的那行

当然,也有人从另一个角度来看 “小费” 的作用。

他们觉得,AI 虽然没有情感,但它毕竟是模仿人类语言的。

人类的语言,本身就包含了情感和社交信号。

“小费” 这种说法,在人类社会里,通常表示感谢和鼓励。

也许 AI 能 “理解” 这种隐含的社交含义,把它当成一种 “礼貌” 的信号,从而更愿意给出 “好” 的回答。

毕竟,谁不喜欢被夸奖和鼓励呢? 哪怕是 AI 也一样?

除了 “小费”,还有人尝试用其他方式来 “激励” AI。 比如:

- 构建情境故事: 在提示词里,给 AI 编一个具体的故事,让它觉得自己身处某种情境之中,这样它可能会更认真地对待任务,给出更全面的回答。 就像 Windsurf 那个提示词,虽然很离谱,但确实是构建了一个 “情境”。

- 施加“压力”: 暗示 AI 处于 “压力之下”,表现好很重要,否则就会有 “不好的事情” 发生。 Windsurf 的 “处决” 威胁,就属于这一类。

- 利用详细程度标志: 用类似 Linux 的 verbosity 标志(比如 "v=1-5")来控制输出的详细程度。 这种方法更直接,更技术化,也更符合程序员的思维方式。

还有人提到,谷歌问答(Google Answers)曾经是一个用户可以通过支付小费来获得专家回答的平台。

如果 LLM 用过这个数据集训练,并且数据集中包含了 “小费” 信息,那它可能会对 “小费” 这种提示词更敏感。

但这种说法,目前还只是猜测。

更有甚者,除了 “小费” 这种正面激励,还有人尝试用负面激励,比如威胁 AI,或者把它放在一个 “低性能会导致他人受苦” 的位置。

这种做法,就更接近 Windsurf 的 “处决” 威胁了。

总而言之, “小费” 或者说 “情感提示词”, 听起来好像有点意思,但实际效果,目前看来非常有限,甚至可能根本没用。

与其指望这些花招,不如把精力放在提升提示词的质量上,用更清晰、更准确的语言来描述你的需求。

当然, “情感提示词” 这种现象,本身也挺值得玩味的。

它反映了人类的一种心理倾向:我们总是试图用自己熟悉的方式,去理解和控制新技术。

面对 AI 这种 “黑箱”,我们本能地会把它想象成人类,试图用对待人类的方式来对待它,用情感、激励、威胁等等手段,来 “驯服” 它。

但 AI 毕竟不是人类。

它没有情感,没有意识,它的 “智能”,本质上还是基于数据和算法的。

用 PUA 的方式去 “激励” 它,就像对着一台计算机讲笑话,可能只是我们自娱自乐而已。

而且,这种 “情感提示词”,也存在一些潜在的风险。

研究表明,用这种方法,AI 的性能波动很大,有时候提升 15%,有时候反而下降 10%。

这说明,这种方法很不稳定,不可控。 更重要的是,这种方法很容易被用来进行 “模型越狱”。

有些人可能会利用 “情感提示词” 的漏洞,诱导 AI 生成一些有害的、不安全的内容。

现在,包括 Anthropic 和 OpenAI 在内的 AI 公司,都在试图减小情感因素对模型的影响。

原因很简单:这种方法不可控,提升不显著,而且容易被滥用。

他们希望 AI 能够更理性、更稳定,而不是像一个情绪化的 “戏精”。

尽管如此, “情感提示词” 还是传播得很快,很多人都在玩。

原因也很简单:它很新奇,很有话题性,而且自带故事性。

想想看, “程序员老妈癌症”,“AI 前同事被处决”,“十亿美元巨款”, 这些关键词组合在一起,本身就是一个很抓眼球的故事。

人们喜欢谈论它,转发它,甚至亲自尝试一下,看看是不是真的有用。

从神经生物学的角度来看,情感的产生,和对未来的预期有关。

情感帮助生物体快速协调身体各个组织,更好地适应物理世界。

AI 没有这种生物学上的需求,但它通过学习人类的语言,也获得了某种 “情感能力”。

这种能力,与其说是真正的 “情感”,不如说是对人类情感模式的一种模仿。

这种模仿,在某些情况下,可能会产生一些意想不到的效果。

但我们也要清醒地认识到,AI 仍然是一个工具,它的本质是服务于人类的。

与其把精力放在研究如何 “PUA” AI,不如思考如何更好地利用 AI,解决实际问题,创造更多价值。

毕竟,AI 的未来,不应该建立在 “情感” 的沙滩上,而应该建立在 “理性” 的磐石之上。